GPT4o爆火背后,AI监管问题再成焦点

近期,OpenAI发布的多模态大模型GPT4o迅速走红,引发全球AI领域的广泛关注。GPT4o不仅展现了前所未有的语音、图像与文字融合能力,也极大提升了AI的应用广度和深度。然而,随着这款“超级AI”的爆火,AI监管问题再次成为舆论和业内热议的焦点。它的强大能力背后,隐藏着哪些风险与挑战?监管又该如何跟上脚步?本文将带你理性看待这场技术与监管的“赛跑”。

GPT4o为何爆火?实力与潜力引关注

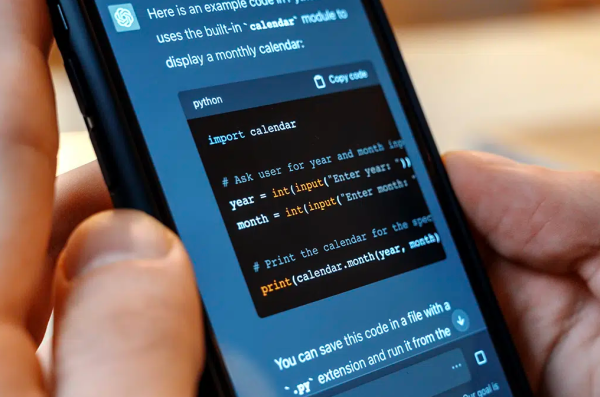

GPT4o作为OpenAI最新力作,集成了多模态信息处理能力,能同时理解和生成语音、图像和文本。这不仅让人机交互更加自然流畅,还大大拓展了AI应用的场景,涵盖教育、医疗、创作、客服等多个领域。

强大的功能让GPT4o快速获得用户和开发者的青睐,推动AI技术进入一个新高度。

监管焦点:为何AI技术越强,监管越重要?

1. 信息安全与隐私保护

GPT4o处理多种形式的个人数据,尤其是语音和图像,涉及大量隐私信息。如何防止数据泄露、滥用成为监管必须重点关注的问题。

2. 内容真实性与偏见风险

AI生成内容有时可能带来误导、虚假信息或强化偏见,尤其是在新闻、教育等领域,监管需确保信息的真实可信和公平公正。

3. 技术滥用与伦理考量

强大的AI可能被用于诈骗、深度伪造、自动化攻击等非法活动,监管框架需要明确禁止和惩治此类行为。

幽默科普:AI监管的“安全带”

想象GPT4o是一辆超跑,跑得飞快,但没有安全带和刹车可不行。AI监管就像是那条安全带,既保障乘客安全,也防止“超速”带来的危险。没有监管,AI这辆“超跑”可能翻车,影响整个社会。

全球AI监管现状与挑战

目前,欧美、亚洲等多个国家和地区纷纷制定或完善AI相关法规,例如欧盟的《人工智能法案》、中国的AI伦理指导原则等,但AI技术发展迅猛,监管立法常面临“滞后”困境。

如何实现创新与安全的平衡,是各国监管者共同面临的难题。

未来监管建议:技术与伦理双管齐下

-

加强数据保护:制定严格的数据采集和使用标准,保障用户隐私;

-

提升透明度:要求AI模型输出可解释,便于监管和用户理解;

-

促进公平与包容:防止算法偏见,保障多样化群体的权益;

-

国际合作:构建全球统一或兼容的AI监管框架,共同应对跨境挑战。

总结

GPT4o的爆火不仅展现了AI技术的巨大进步,也再次提醒我们:技术发展不能脱离监管的轨道。AI监管既是保护用户和社会的“安全网”,也是推动AI健康持续发展的基石。