GPT4o太强了,AI开始“看见”和“听见”人类了!

人工智能(AI)已经不再是只能“打字聊天”的机器人了!OpenAI的最新力作——GPT4o,带来了划时代的突破:AI不只会说话,还能“看见”和“听见”你!是的,你没听错,这款AI已经具备了多模态感知能力,开启了人机交互的全新时代。

GPT4o的“看见”和“听见”究竟是什么?

传统的语言模型只能处理文字信息,而GPT4o则配备了多模态技术,能够同时理解文字、图片,甚至配合语音输入,让AI“听到”人类的声音,准确捕捉更多维度的信息。

举个简单例子:你上传一张旅游照片,GPT4o不仅能帮你生成描述,还能根据图片内容给出旅行建议;或者你用语音提问,AI能准确理解你的语音指令,流畅回应。

这就是AI“看见”和“听见”的威力——它不再是冰冷的文字机器,而是更加聪明、贴心的数字助理。

GPT4o多模态能力的三大惊艳亮点

-

图像理解:让AI“看懂”世界

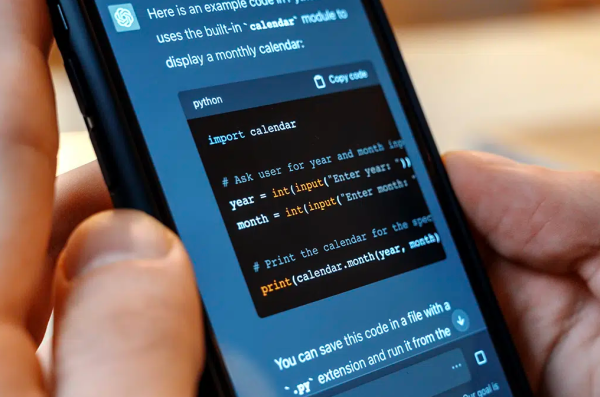

GPT4o能分析图片内容,识别物体、场景,甚至读懂图片里的文字。设计师、内容创作者们再也不用单打独斗,AI能帮你智能生成图像说明,做创意改进建议。 -

语音交互:让AI“听懂”你的声音

通过语音输入,GPT4o能更自然地接收指令,适应不同语调和口音。无论是开会记录,还是生活小助手,语音交互让沟通更便捷。 -

跨模态融合:图片+文字+语音的完美协作

GPT4o能同时处理多种信息,提供更精准、更丰富的回答。比如你给它一张菜单照片,配上“今晚吃什么?”的语音问题,它就能推荐美食,帮你做决定。

这对我们意味着什么?

-

工作效率大提升

无论你是营销人员、程序员,还是设计师,GPT4o都能帮你跨越文字和视觉的壁垒,让工作变得轻松又高效。 -

生活更智能便捷

智能家居、助理机器人再也不是科幻。你的语音指令、家里摄像头拍摄的画面,都能被GPT4o理解,带来贴心服务。 -

AI创意无限可能

艺术创作、内容生成的边界被重新定义。图片与文字结合,让创意更有生命力。

不会用多模态GPT4o?别傻了!

想象一下,拿到一部能“看”和“听”的智能手机,却只会打电话发短信,多浪费!掌握GPT4o的多模态功能,才能真正玩转AI新时代。

结语

GPT4o让AI不再“哑巴”和“盲人”,开始“看见”和“听见”我们。未来的人机互动,注定更加智能、自然、有趣。你准备好了吗?