ChatGPT是否涉嫌“信息剽窃”?原创性争议解析

人工智能文本生成技术的飞速发展,尤其是像ChatGPT这样的大型语言模型,正在引发一场关于**“信息剽窃”与原创性的激烈讨论**。有人质疑:ChatGPT写出来的内容,是不是在“偷别人家的东西”?这到底是事实,还是误解?本文将带你理性解读这场争议,帮你看清AI创作的“真相”。

什么是“信息剽窃”?

“信息剽窃”(plagiarism)通常指未经授权,直接复制或稍作修改他人作品,冒充自己的原创内容。这在学术、创意、新闻等领域都被严厉禁止,因为它侵犯了知识产权和创作者权益。

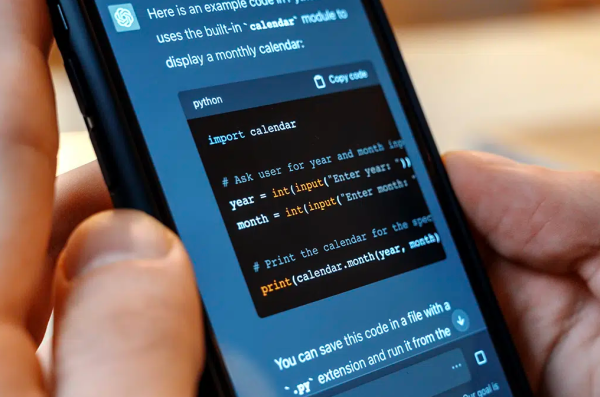

ChatGPT是怎么“写作”的?

ChatGPT并不是简单复制网页内容或文档,而是通过大量语料训练出来的语言模型。它根据输入的提示,生成符合语言规律的新文本,类似于根据记忆拼凑句子,而非复制粘贴。

想象你参加考试答题,是记忆了教科书内容后重新表述,而不是背书抄袭。ChatGPT也是基于统计和模式生成语言。

那么,ChatGPT有没有“剽窃”行为?

-

没有直接复制

ChatGPT生成的内容是原创文本,不是某篇文章的逐字复制。但这不代表完全没有相似段落,因为训练材料中常见表达会影响输出。 -

潜在引用风险

如果提示过于具体,或者训练数据中某些文本权重过高,生成结果可能接近原文,这就需要谨慎对待。 -

版权归属模糊

AI生成内容的版权问题目前在法律界仍是灰色地带,不同国家和平台有不同规定。

争议焦点在哪里?

-

原创性

AI生成内容的原创性和人类创作不同,缺少真正“创造”动机,但在语言表达上具备新颖性。 -

训练数据的合法性

模型训练是否侵犯了原始数据版权?这是许多讨论的核心。 -

道德和法律责任

如果AI内容侵权,谁来承担责任?开发者、用户,还是AI本身?

科普时间:怎么正确使用ChatGPT避免侵权?

-

不要直接发布未经修改的AI文本,尤其涉及版权敏感内容。

-

对AI生成内容进行二次加工润色,确保符合原创要求。

-

标注AI辅助生成信息,提升透明度。

-

结合人工审核,避免误导和信息错误。

未来展望

法律法规完善,AI创作的原创性认定和版权归属将越来越明确。与此同时,AI辅助创作也将变得更普遍,成为内容创作者的好帮手,而非“剽窃工具”。

ChatGPT并不等同于剽窃,但它的“原创性”与人类创作者不同,使用时需要谨慎对待版权和道德问题。把它当成“语言魔术师”,而非“复制机”,你会发现它更多是创新的助力,而非威胁。