ChatGPT是否安全?2025年7月隐私与数据安全分析

一、ChatGPT的数据处理方式

在使用ChatGPT时,用户与AI之间的对话数据会被收集并用于模型的训练和优化。2025年7月,OpenAI明确指出,用户与ChatGPT的互动数据可能会被用于改进模型,但也采取了严格的隐私保护措施。

-

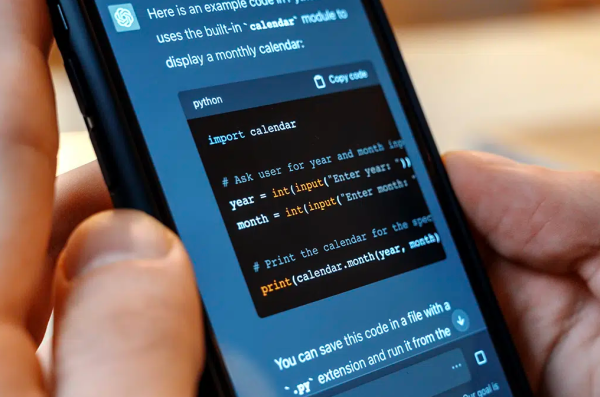

数据使用:OpenAI收集的对话数据主要用于提升模型的理解能力、增强生成的内容质量,并改进用户体验。该数据可能会用于机器学习和研究目的。

-

数据匿名化:OpenAI承诺,所有数据将进行匿名化处理,避免用户的个人信息被泄露。公司声称不会主动从用户对话中提取任何敏感的个人信息,且会对数据进行脱敏处理。

隐私保护的挑战:尽管如此,用户仍需意识到,在一些特殊情况下(如输入敏感信息),模型可能会无意间将这些信息用于训练或分析,这仍然是数据隐私保护的潜在风险。

二、隐私政策与用户控制

2025年7月,OpenAI进一步加强了隐私政策,允许用户对自己的数据拥有更多的控制权。

-

隐私设置:用户可以选择不允许其对话数据用于训练模型。此选项通常可以在OpenAI的隐私设置中找到,用户可以通过账户设置管理数据使用权限。

-

数据删除功能:OpenAI还提供了数据删除功能,允许用户在任何时候删除自己与ChatGPT的对话记录。一旦删除,相关数据将从其服务器中彻底清除。

隐私透明度:OpenAI定期更新隐私政策,并向用户公开数据收集和使用的具体条款,以提高透明度并增强用户信任。

三、数据加密与安全防护

随着AI模型的复杂性增加,数据的加密和安全防护显得尤为重要。OpenAI在2025年7月加强了数据安全性,确保用户对话数据在传输和存储过程中的安全性。

-

加密技术:OpenAI使用高级加密技术(如SSL/TLS)来保护用户与ChatGPT之间的数据传输。这意味着用户与AI之间的对话在网络上传输时,会被加密,防止中途被黑客截获。

-

数据存储安全:OpenAI采用了多层次的数据安全措施来确保存储的用户数据不被非法访问。例如,数据存储系统会使用访问控制和身份验证措施,以确保只有授权人员才能访问数据。

尽管如此,任何在线平台都不能完全排除外部攻击的风险,因此用户应保持警觉,避免在对话中透露敏感信息(如银行账户、身份证号、密码等)。

四、第三方数据共享

OpenAI承诺不会将用户的对话数据出售给第三方,也不会与外部公司共享数据,除非是出于法律合规的要求(如应对法律调查、法院命令等)。此外,OpenAI明确表示,其所收集的数据仅限于用于提高AI性能和研究目的,不会用于其他商业用途。

-

数据共享限制:2025年7月的最新隐私政策强化了这一限制,确保用户数据的共享仅限于OpenAI的运营和技术改善,且不会提供给第三方广告商。

需要注意的是:在一些合作的场景下,如使用Claude或其他集成了ChatGPT的第三方平台时,数据处理和共享的规则可能会有所不同,用户在使用这些平台时应仔细查看各自的隐私政策。

五、用户建议与最佳实践

尽管ChatGPT在数据隐私和安全方面已经做出了许多改进,但用户仍应采取一些措施来确保自己的隐私安全:

-

避免分享敏感信息:在与ChatGPT互动时,尽量避免输入个人敏感信息,如银行账户、密码、健康状况等。

-

定期清理对话记录:如果不希望自己的对话数据被用于模型训练,可以定期删除对话记录,或在隐私设置中关闭数据收集选项。

-

保持系统更新:确保使用ChatGPT时,使用的是OpenAI发布的最新版模型,并且更新了相关的安全补丁,以防范潜在的漏洞或攻击。

六、结语

随着2025年7月的隐私政策更新和安全措施加强,ChatGPT的隐私保护和数据安全性得到了进一步提升。OpenAI在不断优化AI技术的同时,也注重用户数据的隐私和安全。尽管如此,用户在使用ChatGPT时,仍需保持对数据隐私的警觉,并采取必要的安全防护措施。通过合理的隐私设置和使用习惯,用户可以在享受AI带来便利的同时,有效保护个人数据的安全。